Nuestra investigación ha identificado tres tipos de sesgos que hacen que el ecosistema de los medios sociales sea vulnerable a la desinformación tanto intencional como accidental. Es por eso que nuestro Observatorio de Medios Sociales de la Universidad de Indiana está construyendo herramientas para ayudar a la gente a tomar conciencia de estos prejuicios y protegerse de las influencias externas diseñadas para explotarlos.

Sesgo en el cerebro

Los sesgos cognitivos se originan en la forma en que el cerebro procesa la información que cada persona encuentra cada día. El cerebro sólo puede manejar una cantidad finita de información, y demasiados estímulos entrantes pueden causar sobrecarga de información. Esto en sí mismo tiene serias implicaciones para la calidad de la información en los medios sociales. Hemos encontrado que la fuerte competencia por la atención limitada de los usuarios significa que algunas ideas se vuelven virales a pesar de su baja calidad, incluso cuando la gente prefiere compartir contenido de alta calidad.

Para evitar sentirse abrumado, el cerebro utiliza una serie de trucos. Estos métodos suelen ser eficaces, pero también pueden convertirse en sesgos cuando se aplican en contextos equivocados.

Para contrarrestar este sesgo y ayudar a la gente a prestar más atención a la fuente de una reclamación antes de compartirla, desarrollamos Fakey, un juego de alfabetización de noticias para móviles (gratuito en Android e iOS) que simula una fuente de noticias típica de los medios sociales, con una mezcla de artículos de noticias de fuentes convencionales y de baja credibilidad. Los jugadores obtienen más puntos por compartir noticias de fuentes fiables y por marcar contenido sospechoso para comprobar los hechos. En el proceso, aprenden a reconocer señales de credibilidad de la fuente, tales como afirmaciones hiperpartidistas y titulares cargados emocionalmente.

Sesgo en la sociedad

Otra fuente de sesgo proviene de la sociedad. Cuando las personas se conectan directamente con sus pares, los prejuicios sociales que guían su selección de amigos vienen a influir en la información que ven.

La tendencia a evaluar la información más favorablemente si proviene de sus propios círculos sociales crea «cámaras de eco» que están listas para ser manipuladas, ya sea consciente o involuntariamente. Esto ayuda a explicar por qué tantas conversaciones en línea se convierten en confrontaciones «nosotros contra ellos».

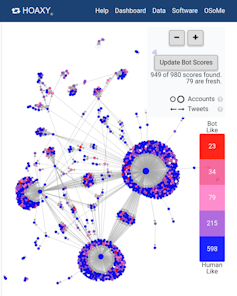

Para estudiar cómo la estructura de las redes sociales en línea hace a los usuarios vulnerables a la desinformación, construimos Hoaxy, un sistema que rastrea y visualiza la difusión de contenido de fuentes de baja credibilidad, y cómo compite con el contenido de verificación de hechos. Nuestro análisis de los datos recopilados por Hoaxy durante las elecciones presidenciales de 2016 en Estados Unidos muestra que las cuentas de Twitter que compartían información errónea estaban casi completamente aisladas de las correcciones hechas por los verificadores de hechos o fact-checkers.

Cuando analizamos las cuentas que difunden información errónea, encontramos un grupo central muy denso de cuentas que se reenvían entre sí casi exclusivamente – incluyendo varios bots. Las únicas veces que las organizaciones de verificación de hechos fueron citadas o mencionadas por los usuarios del grupo mal informado fueron cuando cuestionaron su legitimidad o afirmaron lo contrario de lo que escribieron.

Sesgo en la máquina

El tercer grupo de sesgos surge directamente de los algoritmos utilizados para determinar lo que la gente ve en línea. Tanto las plataformas de medios sociales como los motores de búsqueda los emplean. Estas tecnologías de personalización están diseñadas para seleccionar sólo el contenido más atractivo y relevante para cada usuario individual. Pero al hacerlo, puede terminar reforzando los sesgos cognitivos y sociales de los usuarios, haciéndolos aún más vulnerables a la manipulación.

Nuestra propia investigación muestra que las plataformas de medios sociales exponen a los usuarios a un conjunto menos diverso de fuentes que los sitios de medios no sociales como Wikipedia. Debido a que esto es a nivel de toda una plataforma, no de un solo usuario, lo llamamos el sesgo de homogeneidad.

Otro ingrediente importante de los medios de comunicación social es la información que está en tendencia en la plataforma, de acuerdo a lo que está recibiendo la mayoría de los clics. A este sesgo de popularidad lo llamamos así porque hemos descubierto que un algoritmo diseñado para promover contenido popular puede afectar negativamente la calidad general de la información en la plataforma. Esto también alimenta el sesgo cognitivo existente, reforzando lo que parece ser popular independientemente de su calidad.

Para estudiar estas estrategias de manipulación, desarrollamos una herramienta para detectar robots sociales llamada Botometer. Botometer utiliza el aprendizaje automático para detectar cuentas de bot, inspeccionando miles de diferentes características de las cuentas de Twitter, como la hora de sus mensajes, la frecuencia con la que twittea, y las cuentas que sigue y vuelve a twittear. No es perfecto, pero ha revelado que hasta un 15 por ciento de las cuentas de Twitter muestran signos de ser bots.

Utilizando Botometer junto con Hoaxy, analizamos el núcleo de la red de desinformación durante la campaña presidencial de Estados Unidos en 2016. Encontramos muchos bots que explotan los sesgos cognitivos, de confirmación y de popularidad de sus víctimas y los sesgos algorítmicos de Twitter.

Estos robots son capaces de construir burbujas de filtro alrededor de los usuarios vulnerables, alimentándolos con reclamos falsos e información errónea. En primer lugar, pueden atraer la atención de los usuarios humanos que apoyan a un candidato en particular twitteando los hashtags de ese candidato o mencionando y volviendo a twittear a la persona. Entonces los robots pueden amplificar las afirmaciones falsas que manchan a los oponentes mediante la reedición de artículos de fuentes de baja credibilidad que coinciden con ciertas palabras clave. Esta actividad también hace que el algoritmo destaque para otros usuarios las historias falsas que se están compartiendo ampliamente.

Comprensión de vulnerabilidades complejas

A pesar de que nuestra investigación, y la de otros, muestra cómo los individuos, las instituciones e incluso sociedades enteras pueden ser manipuladas en los medios sociales, quedan muchas preguntas por responder. Es especialmente importante descubrir cómo estos diferentes sesgos interactúan entre sí, creando potencialmente vulnerabilidades más complejas.

Herramientas como la nuestra ofrecen a los usuarios de Internet más información sobre la desinformación y, por lo tanto, cierto grado de protección contra sus daños. Es probable que las soluciones no sean sólo tecnológicas, aunque probablemente contengan algunos aspectos técnicos. Pero deben tener en cuenta los aspectos cognitivos y sociales del problema.

por Giovanni Luca Ciampaglia y Filippo Menczer

Las redes sociales son una de las principales fuentes de noticias en Estados Unidos y en todo el mundo. Sin embargo, los usuarios están expuestos a contenido de precisión cuestionable, incluyendo teorías de conspiración, «clickbait«, contenido hiperpartidista, pseudo-ciencia e incluso «noticias falsas» .

No es sorprendente que haya tanta desinformación publicada: El spam y el fraude en línea son lucrativos para los delincuentes, y la propaganda política y gubernamental produce beneficios tanto partidistas como financieros. Pero el hecho de que el contenido de baja credibilidad se propague tan rápida y fácilmente sugiere que la gente y los algoritmos detrás de las plataformas de medios sociales son vulnerables a la manipulación.

Nuestra investigación ha identificado tres tipos de sesgos que hacen que el ecosistema de los medios sociales sea vulnerable a la desinformación tanto intencional como accidental. Es por eso que nuestro Observatorio de Medios Sociales de la Universidad de Indiana está construyendo herramientas para ayudar a la gente a tomar conciencia de estos prejuicios y protegerse de las influencias externas diseñadas para explotarlos.

Sesgo en el cerebro

Los sesgos cognitivos se originan en la forma en que el cerebro procesa la información que cada persona encuentra cada día. El cerebro sólo puede manejar una cantidad finita de información, y demasiados estímulos entrantes pueden causar sobrecarga de información. Esto en sí mismo tiene serias implicaciones para la calidad de la información en los medios sociales. Hemos encontrado que la fuerte competencia por la atención limitada de los usuarios significa que algunas ideas se vuelven virales a pesar de su baja calidad, incluso cuando la gente prefiere compartir contenido de alta calidad.

Para evitar sentirse abrumado, el cerebro utiliza una serie de trucos. Estos métodos suelen ser eficaces, pero también pueden convertirse en sesgos cuando se aplican en contextos equivocados.

Un atajo cognitivo ocurre cuando una persona está decidiendo si comparte una historia que aparece en su feed de medios sociales. La gente se ve muy afectada por las connotaciones emocionales de un titular, aunque eso no sea un buen indicador de la exactitud de un artículo. Mucho más importante es quién escribió la pieza.

Para contrarrestar este sesgo y ayudar a la gente a prestar más atención a la fuente de una reclamación antes de compartirla, desarrollamos Fakey, un juego de alfabetización de noticias para móviles (gratuito en Android e iOS) que simula una fuente de noticias típica de los medios sociales, con una mezcla de artículos de noticias de fuentes convencionales y de baja credibilidad. Los jugadores obtienen más puntos por compartir noticias de fuentes fiables y por marcar contenido sospechoso para comprobar los hechos. En el proceso, aprenden a reconocer señales de credibilidad de la fuente, tales como afirmaciones hiperpartidistas y titulares cargados emocionalmente.

Sesgo en la sociedad

Otra fuente de sesgo proviene de la sociedad. Cuando las personas se conectan directamente con sus pares, los prejuicios sociales que guían su selección de amigos vienen a influir en la información que ven.

De hecho, en nuestra investigación hemos encontrado que es posible determinar las tendencias políticas de un usuario de Twitter simplemente mirando las preferencias partidistas de sus amigos. Nuestro análisis de la estructura de estas redes de comunicación partidistas encontró que las redes sociales son particularmente eficientes en la difusión de información – precisa o no – cuando están estrechamente vinculadas y desconectadas de otras partes de la sociedad.

La tendencia a evaluar la información más favorablemente si proviene de sus propios círculos sociales crea «cámaras de eco» que están listas para ser manipuladas, ya sea consciente o involuntariamente. Esto ayuda a explicar por qué tantas conversaciones en línea se convierten en confrontaciones «nosotros contra ellos».

Para estudiar cómo la estructura de las redes sociales en línea hace a los usuarios vulnerables a la desinformación, construimos Hoaxy, un sistema que rastrea y visualiza la difusión de contenido de fuentes de baja credibilidad, y cómo compite con el contenido de verificación de hechos. Nuestro análisis de los datos recopilados por Hoaxy durante las elecciones presidenciales de 2016 en Estados Unidos muestra que las cuentas de Twitter que compartían información errónea estaban casi completamente aisladas de las correcciones hechas por los verificadores de hechos o fact-checkers.

Cuando analizamos las cuentas que difunden información errónea, encontramos un grupo central muy denso de cuentas que se reenvían entre sí casi exclusivamente – incluyendo varios bots. Las únicas veces que las organizaciones de verificación de hechos fueron citadas o mencionadas por los usuarios del grupo mal informado fueron cuando cuestionaron su legitimidad o afirmaron lo contrario de lo que escribieron.

Sesgo en la máquina

El tercer grupo de sesgos surge directamente de los algoritmos utilizados para determinar lo que la gente ve en línea. Tanto las plataformas de medios sociales como los motores de búsqueda los emplean. Estas tecnologías de personalización están diseñadas para seleccionar sólo el contenido más atractivo y relevante para cada usuario individual. Pero al hacerlo, puede terminar reforzando los sesgos cognitivos y sociales de los usuarios, haciéndolos aún más vulnerables a la manipulación.

Por ejemplo, las herramientas publicitarias detalladas incorporadas en muchas plataformas de medios sociales permiten a los defensores de las campañas de desinformación explotar el sesgo de confirmación adaptando los mensajes a las personas que ya están inclinadas a creer en ellos.

Además, si un usuario hace clic con frecuencia en los enlaces de Facebook de una fuente de noticias en particular, Facebook tenderá a mostrarle a esa persona más contenido de ese sitio. Este efecto de la llamada «burbuja de filtro» puede aislar a las personas de diversas perspectivas, reforzando el sesgo de confirmación.

Nuestra propia investigación muestra que las plataformas de medios sociales exponen a los usuarios a un conjunto menos diverso de fuentes que los sitios de medios no sociales como Wikipedia. Debido a que esto es a nivel de toda una plataforma, no de un solo usuario, lo llamamos el sesgo de homogeneidad.

Otro ingrediente importante de los medios de comunicación social es la información que está en tendencia en la plataforma, de acuerdo a lo que está recibiendo la mayoría de los clics. A este sesgo de popularidad lo llamamos así porque hemos descubierto que un algoritmo diseñado para promover contenido popular puede afectar negativamente la calidad general de la información en la plataforma. Esto también alimenta el sesgo cognitivo existente, reforzando lo que parece ser popular independientemente de su calidad.

Todos estos sesgos algorítmicos pueden ser manipulados por los robots sociales, programas informáticos que interactúan con los humanos a través de los medios de comunicación social. La mayoría de los robots sociales, como Big Ben de Twitter, son inofensivos. Sin embargo, algunos ocultan su verdadera naturaleza y se utilizan con fines maliciosos, como fomentar la desinformación o crear falsamente la apariencia de un movimiento de base, también llamado «astroturfing». Encontramos evidencia de este tipo de manipulación en el período previo a las elecciones de mitad de período de Estados Unidos de 2010.

Para estudiar estas estrategias de manipulación, desarrollamos una herramienta para detectar robots sociales llamada Botometer. Botometer utiliza el aprendizaje automático para detectar cuentas de bot, inspeccionando miles de diferentes características de las cuentas de Twitter, como la hora de sus mensajes, la frecuencia con la que twittea, y las cuentas que sigue y vuelve a twittear. No es perfecto, pero ha revelado que hasta un 15 por ciento de las cuentas de Twitter muestran signos de ser bots.

Utilizando Botometer junto con Hoaxy, analizamos el núcleo de la red de desinformación durante la campaña presidencial de Estados Unidos en 2016. Encontramos muchos bots que explotan los sesgos cognitivos, de confirmación y de popularidad de sus víctimas y los sesgos algorítmicos de Twitter.

Estos robots son capaces de construir burbujas de filtro alrededor de los usuarios vulnerables, alimentándolos con reclamos falsos e información errónea. En primer lugar, pueden atraer la atención de los usuarios humanos que apoyan a un candidato en particular twitteando los hashtags de ese candidato o mencionando y volviendo a twittear a la persona. Entonces los robots pueden amplificar las afirmaciones falsas que manchan a los oponentes mediante la reedición de artículos de fuentes de baja credibilidad que coinciden con ciertas palabras clave. Esta actividad también hace que el algoritmo destaque para otros usuarios las historias falsas que se están compartiendo ampliamente.

Comprensión de vulnerabilidades complejas

A pesar de que nuestra investigación, y la de otros, muestra cómo los individuos, las instituciones e incluso sociedades enteras pueden ser manipuladas en los medios sociales, quedan muchas preguntas por responder. Es especialmente importante descubrir cómo estos diferentes sesgos interactúan entre sí, creando potencialmente vulnerabilidades más complejas.

Herramientas como la nuestra ofrecen a los usuarios de Internet más información sobre la desinformación y, por lo tanto, cierto grado de protección contra sus daños. Es probable que las soluciones no sean sólo tecnológicas, aunque probablemente contengan algunos aspectos técnicos. Pero deben tener en cuenta los aspectos cognitivos y sociales del problema.